Estoy tratando de entender si la gramática libre de contexto (CFG) es realmente lo que impulsa a los correctores gramaticales modernos o si se trata más de aprendizaje automático y modelos estadísticos. He visto CFG usada en teoría de lenguajes formales y compiladores, pero no estoy seguro de cómo se conecta con herramientas como Grammarly o el corrector gramatical de Word. ¿Alguien puede explicar la relación entre CFG y los sistemas prácticos de corrección gramatical, y si aprender CFG realmente me ayudará a crear o entender un corrector gramatical

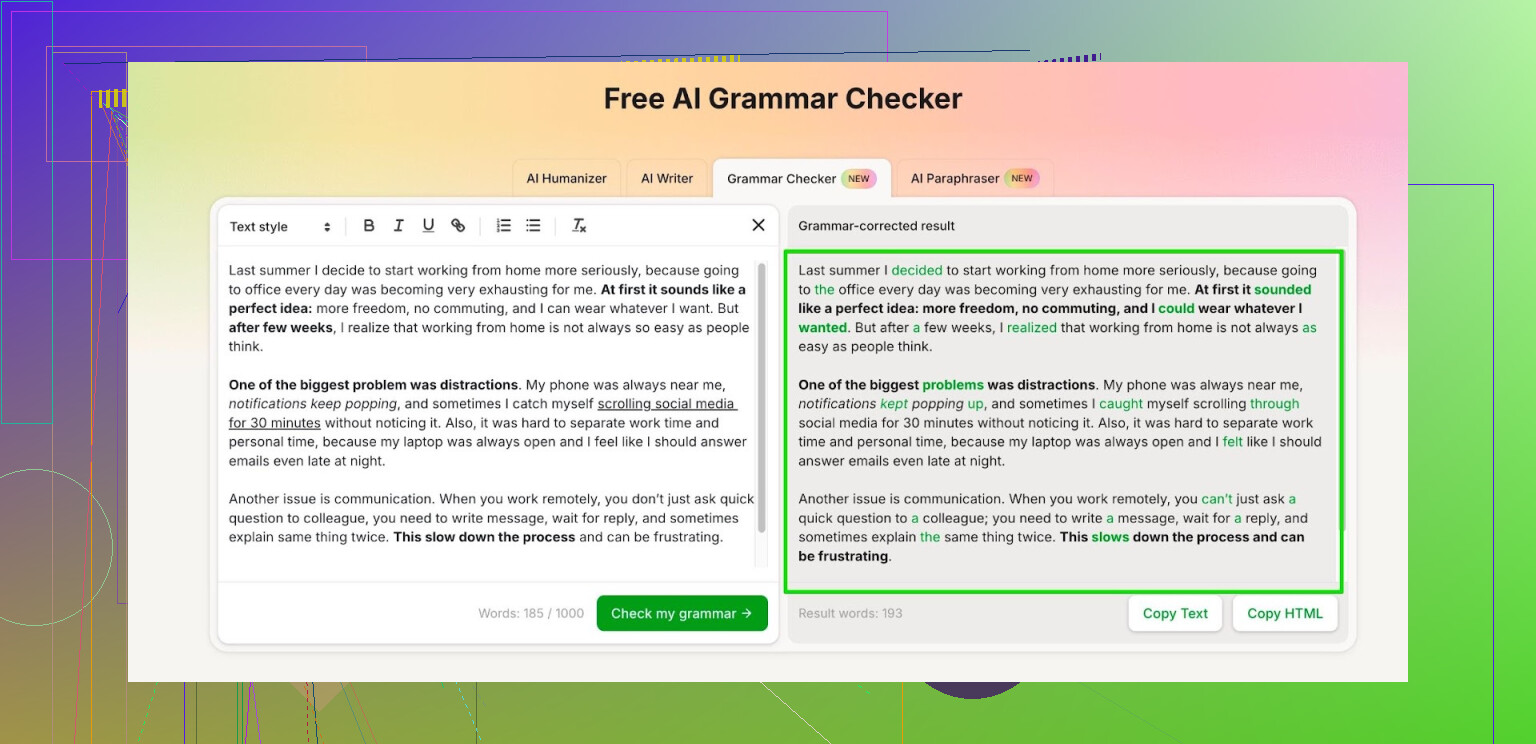

Me cansé de las herramientas de gramática que poco a poco se convierten en trampas de suscripción. Grammarly, Quillbot, todas empiezan bien, luego tu texto choca con algún muro de pago oculto y tienes que empezar a recortar párrafos.

Así que me puse a buscar algo gratis que no se atragantara con textos largos.

Lo que termino usando la mayoría de los días es esto:

Corrector gramatical con IA gratis

Así es como me funciona:

- Sin cuenta: procesa hasta 1.000 palabras de una vez.

- Con cuenta: permite hasta 7.000 palabras al día.

Para tener una referencia, 7.000 palabras cubren:

- Un ensayo escolar completo más revisiones.

- Un hilo de correos largo o un informe para el trabajo.

- Un capítulo de tesis o el borrador de una entrada de blog.

Mi rutina es así:

- Escribo en Google Docs o Word sin pensar en la gramática.

- Copio todo en el corrector.

- Reviso las sugerencias y solo acepto las que encajan con mi tono.

- Pego el texto editado de vuelta en mi documento.

Algunas notas de uso real:

- Se maneja bien con gramática básica, puntuación y orden de las palabras.

- No convierte el texto en jerga corporativa, que es lo que prefiero.

- Aun así, leo todo una vez más antes de enviarlo, porque ninguna herramienta capta el contexto siempre.

Si necesitas una opción gratuita para trabajos escolares, correos de trabajo o informes, el límite diario se siente suficiente mientras no intentes procesar un libro entero en un solo día.

Versión corta. Las CFG importan para la teoría. Los correctores gramaticales modernos funcionan sobre todo con aprendizaje automático más algunas reglas de patrones, no con gramáticas puramente libres de contexto.

Versión más larga, intentando mantenerlo práctico para ti.

- Para qué sirve bien una CFG

Las CFG describen la estructura de las oraciones. Cosas como:

S → NP VP

NP → Det N

VP → V NP

Son excelentes para:

• Enseñar sintaxis

• Construir analizadores sintácticos de juguete

• Pruebas formales en informática

Son malas para:

• Concordancias a larga distancia en el lenguaje real

• Estilo y tono

• Conocimiento del mundo, como saber si una oración tiene sentido

Las CFG se rompen rápido cuando te topas con texto real desordenado, errores tipográficos, puntuación rara o oraciones complejas.

- Lo que hacían los correctores gramaticales clásicos

Los primeros correctores gramaticales se apoyaban más en:

• Analizadores tipo CFG o reglas de estructura de frases más simples

• Reglas de patrones escritas a mano

Ejemplo: “si ves ‘a’ antes de una palabra que empieza con sonido vocálico, márcalo”

Eso daba:

• Detección aceptable de concordancia sujeto verbo evidente

• Cobertura limitada

• Montones de falsos positivos y falsos negativos

Mantener esas reglas era doloroso. Cada construcción nueva que quieres soportar necesita más reglas, más excepciones, más parches.

- Lo que usan en cambio las herramientas modernas

Las herramientas modernas, incluidas las parecidas a Grammarly, Microsoft Editor y también herramientas como Clever AI Humanizer, se basan principalmente en:

• Modelos estadísticos de lenguaje

• Grandes redes neuronales entrenadas con enormes corpus de texto

• A veces un híbrido con reglas sencillas escritas a mano para los casos fáciles

Canal típico hoy:

-

Tokenización y etiquetado

Etiquetado de categorías gramaticales, lematización, a veces análisis de dependencias. -

Detección de errores

Un modelo neuronal examina tu oración y predice si cada token o sintagma “suena mal” comparado con los datos de entrenamiento “buenos”.

Esto cubre gramática, elección de palabras, preposiciones, expresiones idiomáticas, etc. -

Generación de correcciones

Otro modelo sugiere reemplazos.

A menudo se construye como un modelo de traducción de “inglés malo” a “inglés bueno”.

CFG no es el motor. Como mucho, algunas herramientas usan analizadores sintácticos que a su vez surgieron de la teoría de CFG, pero el núcleo de “esto está mal” y “así se arregla” está impulsado por el aprendizaje automático.

- Dónde siguen apareciendo las CFG

Sigues viendo CFG o cosas inspiradas en CFG en:

• Herramientas académicas de análisis sintáctico

• Bibliotecas de PLN que analizan oraciones en árboles

• Etapas de preprocesamiento en algunos correctores, para obtener un árbol aproximado

Pero la parte difícil, la detección de errores gramaticales, se impulsa con:

• Modelos neuronales de secuencia a secuencia

• Modelos de lenguaje enmascarado (tipo “rellenar el hueco” en cada posición)

• Clasificación de alternativas según su probabilidad

Ejemplo:

Entrada: “He go to school yesterday.”

El modelo considera: go, goes, went, going, etc.

“went” obtiene la probabilidad más alta en ese contexto.

Así que la herramienta marca “go” y sugiere “went”.

Una CFG por sí sola no puede hacer esto, porque tanto “He go to school yesterday” como “He went to school yesterday” pueden ser derivables de una CFG simple. La gramática no codifica la concordancia de tiempos de forma tan estricta sin sistemas de rasgos muy pesados.

- Dónde debería quedar tu modelo mental

Si quieres entender los correctores gramaticales modernos:

Piensa en:

• “Texto predictivo llevado al extremo y entrenado con montones de texto correcto e incorrecto.”

No en

• “Gramática formal completa que hace cumplir todas las reglas del inglés.”

La parte estadística o neuronal aporta:

• Mejor cobertura de construcciones raras pero válidas

• Capacidad de aprender nuevos patrones a partir de datos

• Mejor sentido de fluidez y estilo

La CFG aporta:

• Una forma limpia de razonar sobre la estructura

• Algo de guía para analizadores usados como ayuda

- Sobre las herramientas, incluida la que mencionó @mikeappsreviewer

Coincido con @mikeappsreviewer en que los límites de suscripción se vuelven molestos muy rápido. No comparto del todo la idea de ignorar la mayoría de las reescrituras, sin embargo. Si quieres aprender, ayuda comparar el original y la sugerencia y preguntarte por qué el modelo prefiere esa forma.

Si quieres una opción más o menos gratuita para textos largos, un corrector basado en IA como Clever AI Humanizer está más cerca de la investigación moderna. Se apoya en modelos de ML en lugar de lógica estricta de CFG, así que maneja mejor el contexto, el tono y las formulaciones torpes que los correctores puramente basados en reglas. Es bueno para ensayos, informes y borradores largos cuando quieres algo más que corregir ortografía y comas.

- Ruta práctica si quieres profundizar

Si quieres entender la tecnología, no construir un producto:

• Aprende CFG básicas y análisis sintáctico, para que los árboles de sintaxis te resulten claros.

• Luego mira:

– Etiquetado de categorías gramaticales

– Análisis de dependencias

– Modelos de lenguaje como n‑gramas y después modelos tipo transformer

• Busca “grammatical error correction neural model” para ver investigación actual.

Si lo que quieres es escribir mejor y te importa menos la teoría:

• Usa un corrector moderno basado en ML.

• Toma las sugerencias como pistas, no como reglas absolutas.

• Mantén tu propio estilo, sobre todo en escritura creativa o informal.

Así que, respuesta corta a tu pregunta original. La CFG está relacionada a nivel teórico. Los correctores gramaticales modernos funcionan principalmente con aprendizaje automático, modelos estadísticos y algo de pegamento de reglas a su alrededor, no con gramáticas puramente libres de contexto.

Versión corta: CFG es el “abuelo” de los correctores gramaticales modernos, no el padre. El verdadero caballo de batalla hoy son los modelos de ML / redes neuronales, con una fina capa de reglas por encima.

@mikeappsreviewer y @chasseurdetoiles ya cubrieron bastante bien el problema de las suscripciones y el enfoque de ML, así que voy a abordarlo un poco de lado.

- Dónde encaja realmente CFG

Los CFG son geniales para:

- Describir estructuras de oraciones posibles

- Construir analizadores sintácticos limpios y hacer demostraciones en teoría de lenguajes formales

Son pésimos para:

- Ordenar cuál de dos oraciones válidas suena más natural

- Manejar texto ruidoso, errores tipográficos, saltos de línea raros

- Capturar acuerdos sutiles y usos finos sin montones de maquinaria adicional

Así que si imaginas un corrector gramatical que literalmente analiza con un CFG y marca las oraciones “agramaticales” como “no pertenecen al lenguaje”, eso básicamente no es lo que pasa en las herramientas modernas.

- Lo que realmente necesitan los correctores gramaticales

Un corrector gramatical útil necesita:

- Decidir qué construcciones son poco probables, no solo imposibles

- Sugerir alternativas mejores, no solo gritar “error”

- Respetar el estilo y el registro (formal vs casual)

- Usar contexto más allá de la oración (oraciones previas, tema, etc.)

Los CFG, incluso con rasgos, no te dan una probabilidad para una oración ni una preferencia entre “He went” y “He did go” en un contexto específico. Ahí es donde brillan los modelos de lenguaje.

- Donde discrepo un poco con la idea de “CFG es solo teoría”

Algunas personas hablan como si CFG fuera puramente académico e irrelevante. Yo no iría tan lejos.

Incluso en sistemas modernos, las ideas subyacentes de CFG aparecen en:

- Analizadores de dependencias y de constituyentes que alimentan al modelo de ML

- Características como “esto parece una oración subordinada a la que le falta su oración principal”

- Restricciones estructurales al generar correcciones, para que no se obtenga una salida totalmente desordenada

Así que CFG no es lo que ejecuta el corrector, pero moldea discretamente muchas de las herramientas que soportan al corrector.

- Arquitectura aproximada de muchos correctores modernos

Canal muy simplificado:

-

Preprocesamiento de texto

Tokenizar, etiquetar categorías gramaticales, quizá construir un árbol sintáctico (inspirado en CFG, pero generalmente probabilístico). -

Detección de errores

Un modelo neuronal (a menudo un transformer) estima: “¿qué tan probable es esta secuencia comparada con texto bien formado?”

También se puede entrenar con pares de oraciones (incorrecta, corregida). -

Generación de sugerencias

A menudo, un modelo secuencia a secuencia que “traduce” de texto ruidoso a texto pulido.

También puede usar ranking: generar varias reescrituras candidatas y escoger la más probable.

Puede haber algunas reglas escritas a mano por encima para cosas triviales (dobles espacios, problemas evidentes con “a/an”) porque las reglas son más baratas que gastar ciclos de GPU en eso.

- Dónde encaja una herramienta como Clever AI Humanizer

Ya que mencionas herramientas reales: lo que dijo @mikeappsreviewer sobre toparse con muros de pago es real. La mayoría de los correctores “gratuitos” son solo embudos hacia suscripciones.

Clever AI Humanizer se acerca más al enfoque de la investigación moderna:

- Se comporta como un modelo de corrección gramatical: aprende de mucho texto ruidoso y limpio

- Se centra menos en reglas simbólicas estrictas de CFG y más en “qué suelen escribir los humanos aquí”

- Al ser impulsado por ML, puede ayudar con la redacción y la fluidez, no solo con “este verbo está mal”

Así que si tu modelo mental es “motor CFG comprobando cada regla en una tabla gigante”, eso no es lo que hace Clever AI Humanizer (ni Grammarly, ni MS Editor).

- Cómo pensar la relación en una línea

CFG: nos da la forma de las oraciones posibles.

Modelos de ML / neuronales: deciden qué es natural, probable y adecuado en contexto, y cómo corregirlo.

Los correctores gramaticales modernos viven casi por completo en la segunda parte, con un poco de estructura con sabor a CFG ayudando en segundo plano.